डीपफेक,एक विनाशकारी दुनिया

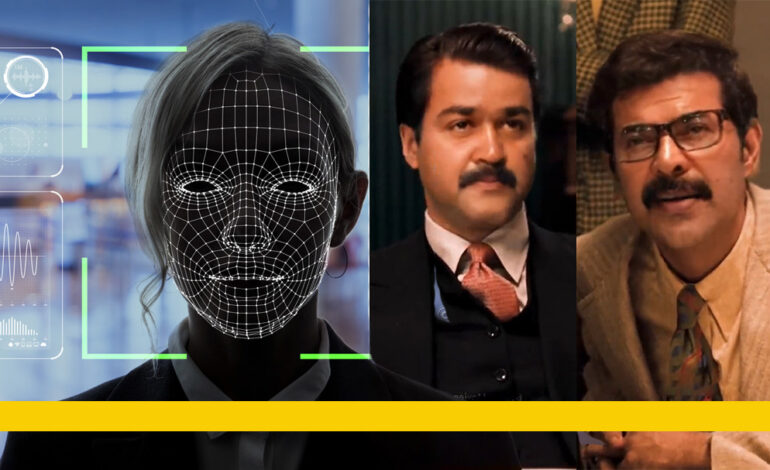

हाल ही में, मलयालम सोशल मीडिया प्लेटफॉर्म पर 1972 की क्लासिक, द गॉडफादर के एक दृश्य पर आधारित एक वायरल मीडिया क्लिप देखी गई । हालाँकि, जिस चीज़ ने इस प्रस्तुति को मलयाली लोगों के बीच हिट बना दिया, वह थी माइकल कोरलियोन (अल पचिनो), मो ग्रीन (एलेक्स रोक्को), और फ्रेडो कोरलियोन (जॉन कैज़ेल) की भूमिकाओं को अत्याधुनिक कृत्रिम बुद्धिमता प्रौद्योगिकी उपकरणों में से एक , डीप फेक के माध्यम से क्रमशः मलयालम सुपरस्टार मोहनलाल, ममूटी और फहद फाजिल के द्वारा प्रतिस्थापित करना। भले ही यह उपकरण कुछ समय से मौजूद है, शायद यह पहली बार है कि आम मलयाली ने इस विशेष जेनरेटर एआई तकनीक पर ध्यान दिया है।

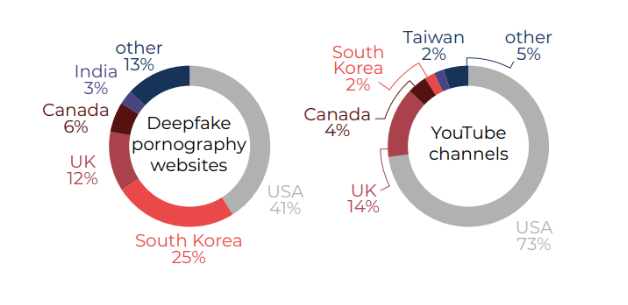

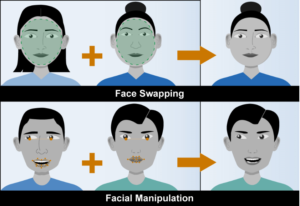

जैसा कि हर कोई देख सकता है, यह रचनात्मक और मनोरंजन उद्योग के लिए असंख्य संभावनाओं के द्वार खोलता है। आप ऐतिहासिक वीडियो में लोकप्रिय हस्तियों की तस्वीरें डाल सकते हैं या हॉलीवुड के क्लासिक अभिनेताओं को मलयालम बोलने पर मजबूर कर सकते हैं। क्या आपको तमिल फिल्म ‘इंडियन ‘ का मशहूर सीन याद है जहां नायक सेनापति को सुभाष चंद्र बोस से पदक मिलता है? कृत्रिम बुद्धिमत्ता के उपयोग से ऐसे कंप्यूटर ग्राफिक्स-संबंधी दृश्य बनाना बहुत आसान हो गया है। चैट जीपीटी और डाल ई 2 जैसी अन्य जेनेरिक कृत्रिम बुद्धिमता तकनीकों के विपरीत, जो टेक्स्ट और छवियों से संबंधित हैं, डीपफेक के दुरुपयोग का एक बड़ा खतरा पैदा होने वाला है। ऐसे कृत्रिम रूप से बनाए गए वीडियो/ऑडियो का उपयोग दुर्भावनापूर्ण उद्देश्यों के लिए किया जा सकता है जैसे लोगों को ब्लैकमेल करना, या गलत सूचना फैलाकर और उनकी छवियों से संबंधित अश्लीलता फैलाकर किसी की प्रतिष्ठा को नुकसान पहुंचाना। अग्रणी एआई रिसर्च फर्म डीप ट्रेस की 2018 की रिपोर्ट के अनुसार ऑनलाइन पाए गए 96% डीपफेक वीडियो आश्चर्यजनक रूप से अश्लील थे। पहले, डीपफेक वीडियो बनाने के लिए उच्च कम्प्यूटेशनल शक्ति, बड़े डेटासेट और उन्नत मशीन लर्निंग एल्गोरिदम का ज्ञान बहुत आवश्यक था। लेकिन जेनरेटिव एआई प्रौद्योगिकियों में नवीनतम प्रगति के साथ, सीमित मशीन लर्निंग विशेषज्ञता वाले लोग बहुत कम फ़ोटो और नकली वीडियो के साथ इस तकनीक का उपयोग कर सकते हैं। यह स्पष्ट रूप से समाज के लिए कई नैतिक, कानूनी और सामाजिक चिंताओं को जन्म देता है।

राजनीतिक प्रभाव

गलत सूचना , पिछले कुछ समय से ऑनलाइन दुनिया के सामने आने वाली प्रमुख चुनौतियों में से एक बन गई है। हाल के दिनों में, हमने विशेष रूप से चुनावों के दौरान विकास की तस्वीरें होने का दावा करने वाली फ़ोटोशॉप्ड नकली छवियों की बाढ़ देखी है। भारत जैसे देश में जहां इंटरनेट का परिदृश्य और पहुंच व्यापक है और जवाबदेही न्यूनतम है, फर्जी खबरें, आधी-अधूरी सच्चाई, गपशप और निराधार अफवाहों का तेजी से प्रसार उत्सुक लोगों को ढूंढ लेता है।

उदाहरण के लिए, एक दुर्भावनापूर्ण उपयोगकर्ता किसी राजनेता का डीपफेक वीडियो/ऑडियो बना सकता है जिसमें वह कुछ ऐसा कह रहा हो जो उसने कभी नहीं कहा हो। इस तरह की गलत सूचना राजनेता की चुनावी संभावनाओं को प्रभावित करते हुए छोटी और लंबी अवधि में उसकी प्रतिष्ठा को नुकसान पहुंचा सकती है। वास्तव में, इस तरह की रणनीति पहले से ही अपनाई जा रही है लेकिन हमारे पास इसका मुकाबला करने के लिए कोई विशिष्ट तंत्र नहीं है।

उदाहरण के लिए, कुछ दिन पहले कांग्रेस नेता राहुल गांधी का फर्जी वीडियो पोस्ट करने के आरोप में बीजेपी की आईटी विंग के राष्ट्रीय प्रमुख अमित मालवीय के खिलाफ कर्नाटक में मामला दर्ज किया गया था. इससे राजनीतिक हंगामा मच गया और लंबी कानूनी लड़ाई चल रही है।

डीपफेक क्या है और इसकी शुरुआत कैसे हुई?

2017 में, गैल गैडोट (द वंडर वुमन स्टार) का एक फर्जी सेक्स वीडियो ऑनलाइन प्लेटफॉर्म रेडिट पर सामने आया था । जिस पोर्न वीडियो में उनके खिलाफ अनाचार का आरोप लगाया गया था, वह एक पोर्न स्टार के शरीर पर गैल गैडोट का चेहरा चिपकाकर डीप-लर्निंग एल्गोरिदम से बनाया गया था। इसकी उत्पत्ति रेडिट हैंडल से छद्म नाम ‘डीपफेक’ के साथ हुई थी। ऐसा माना जाता है कि यह डीपफेक तकनीक के प्रभाव का पहला सार्वजनिक प्रदर्शन था और इस तकनीक का नाम उस Reddit हैंडल के नाम पर रखा गया था।

आप डीपफेक को कैसे पहचान सकते हैं?

जैसे-जैसे मशीन-लर्निंग एल्गोरिदम स्मार्ट होते जा रहे हैं, मानव आंखों से डीपफेक का पता लगाना कठिन होता जा रहा है। हालाँकि, कम प्रशिक्षित व्यक्ति द्वारा बनाए गए डीपफेक की पहचान करने के लिए ये कुछ सुझाव हैं।

त्वचा का असामान्य रंग और प्रकाश व्यवस्था ऑडियो गुणवत्ता में अंतर शरीर का अप्राकृतिक आकार या हरकतें आंखों का अप्राकृतिक रूप से बार- बार हिलना

2018 में डीपफेक के शुरुआती दिनों के दौरान, शोधकर्ताओं ने पाया कि डीपफेक आंखें नहीं झपकती हैं। इसका मुख्य कारण यह था कि मॉडलों को उन छवियों के साथ प्रशिक्षित किया गया था जिनकी आँखें खुली थीं (जो सार्वजनिक डोमेन में उपलब्ध थीं)। इसके अवलोकन के बाद, बाद के संस्करणों में इस समस्या को ‘ठीक’ कर दिया गया और डीपफेक चेहरे झपकने लगे। यह केवल उस तीव्र दौड़ को रेखांकित करता है जिसमें हम लगे हुए हैं। इस दिशा में बहुत सारे अकादमिक शोध हो रहे हैं।

सरकारें डीपफेक से कैसे निपट रही हैं?

कोई यह तर्क दे सकता है कि यह तकनीक समस्या हल करने के बदले अधिक समस्याएं पैदा करती है। बदला लेने वाले पोर्न और राजनीतिक रूप से उकसाने वाले वीडियो दुनिया भर की कानूनी प्रणालियों के लिए कड़ी चुनौती पेश करेंगे। पिछले कुछ वर्षों में, संयुक्त राज्य अमेरिका, चीन और यूनाइटेड किंगडम सहित कई देशों ने इस नई समस्या से निपटने के लिए कानूनों में संशोधन करना शुरू कर दिया है।

यूनाइटेड किंगडम में, रिवेंज पोर्न, ताक-झांक और डीपफेक जैसे मुद्दों के समाधान के लिए ऑनलाइन सुरक्षा बिल संशोधन प्रक्रिया 2022 में शुरू हुई; और अब ब्रिटेन ने अंतरंगता दिखाने वाली डीपफेक तस्वीरों के आदान-प्रदान को अपराध घोषित कर दिया है। चीन ने भी देश के इंटरनेट नियामक, साइबरस्पेस एडमिनिस्ट्रेशन ऑफ चाइना (सीएसी) के दिशानिर्देशों के आधार पर जनवरी 2023 में डीपफेक के निर्माण पर प्रतिबंध लगा दिया है। संयुक्त राज्य अमेरिका गैर-सहमति वाली एआई-जनित अश्लीलता साझा करने पर प्रतिबंध लगाने और इसे अवैध बनाने की योजना बना रहा है। कांग्रेसी जो मोरेल द्वारा पेश किया गया एक विधेयक इस समय चर्चा में है। भारत भी डीपफेक से उत्पन्न चुनौतियों से निपटने के लिए इसी दिशा में आगे बढ़ने पर विचार कर सकता है।

सन्दर्भ:

https://www.gov.uk/govt/news/new-laws-to-better-protect-victims-from-abuse-of-intimate-images

https://regmedia.co.uk/2019/10/08/डीपफेक_

https://www.vice.com/en/article/gydydm/gal-gadot-fake-ai-porn